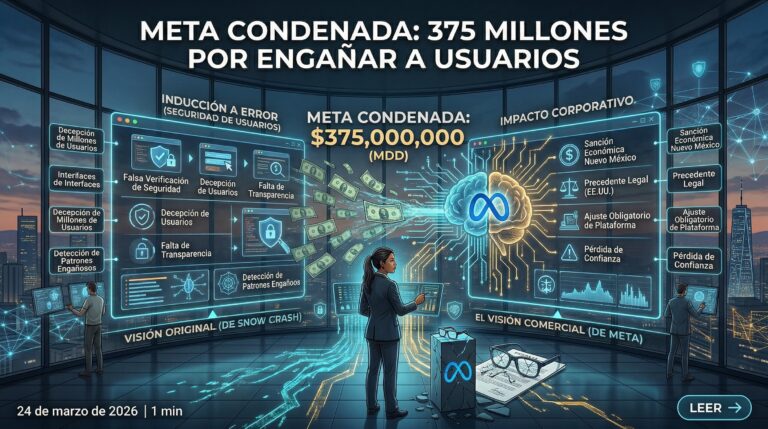

Meta condenada: 375 millones por engañar a usuarios

Meta condenada: 375 millones por engañar a usuarios

iamanos.com, la agencia de Inteligencia Artificial líder en México con experiencia de nivel Silicon Valley, te trae las noticias más disruptivas del mundo tecnológico. Un jurado acaba de marcar un antes y un después en la historia de la regulación tecnológica. Meta, el gigante detrás de Facebook e Instagram, fue condenado a pagar 375 millones de dólares por engañar deliberadamente a sus usuarios. La era de la impunidad corporativa digital está llegando a su fin, y las empresas que no operen con transparencia pagarán el precio más alto: su reputación y su capital.

El Veredicto que Sacude a la Industria Tecnológica Global

En un fallo sin precedentes dentro del sistema judicial estadounidense, un jurado del estado de Nuevo México determinó que Meta actuó de forma deliberada y sistemática para inducir a error a millones de usuarios respecto a la seguridad real de sus plataformas. La sanción impuesta asciende a 375 millones de dólares, una cifra que, si bien puede parecer manejable para una empresa con la capitalización de Meta, representa algo infinitamente más valioso para la industria: un precedente legal vinculante.

El tribunal calificó la conducta de la compañía como una práctica comercial abusiva, lo que en términos jurídicos eleva el nivel de responsabilidad muy por encima de una negligencia simple. Según reportó The Verge, el jurado concluyó que Meta violó deliberadamente la legislación estatal al presentar sus plataformas como entornos seguros cuando los datos internos de la marca-2026/” target=”_blank” rel=”noopener noreferrer”>propia empresa contradecían esas afirmaciones públicas.

En este 2026, este fallo no es solo una noticia legal. Es una señal de alarma para todo el ecosistema tecnológico: los directivos de empresas que operan plataformas digitales —con o sin componentes de inteligencia artificial— deben revisar de forma urgente sus protocolos de comunicación pública sobre seguridad y privacidad.

¿Qué alegó el estado de Nuevo México contra Meta?

La demanda presentada por el estado de Nuevo México se centró en demostrar que Meta tenía conocimiento interno de los riesgos que sus plataformas representaban para segmentos vulnerables de la población, incluyendo menores de edad, y aun así continuó comunicando públicamente mensajes que contradecían esa realidad. Los argumentos del jurado giraron en torno a tres ejes centrales: primero, la existencia de documentación interna que evidenciaba daños conocidos; segundo, la continuación deliberada de prácticas de diseño que maximizaban el tiempo de uso en detrimento del bienestar; y tercero, la omisión activa de información crítica para los consumidores. La calificación como práctica comercial abusiva, y no simplemente como negligencia, es el elemento que convierte este caso en una bomba regulatoria de largo alcance.

¿Listo para implementar IA en tu empresa?

Cotiza tu proyecto en menos de 5 minutos

Sin compromiso. Sin tecnicismos. Solo resultados.

El impacto inmediato sobre el valor corporativo y la confianza institucional

Para un director de marca-2026/” target=”_blank” rel=”noopener noreferrer”>tecnología o un CEO que analiza este fallo desde una perspectiva estratégica, el dato más relevante no es la cifra de 375 millones de dólares. La verdadera pérdida para Meta es de naturaleza intangible: la confianza institucional. En un entorno donde los reguladores de la Unión Europea, el Reino Unido, Brasil y múltiples estados de Estados Unidos están construyendo marcos legales cada vez más agresivos contra las grandes tecnológicas, este veredicto otorga munición jurídica y argumentativa a fiscales y legisladores de todo el mundo. Se estima que para 2027, más del 60% de las jurisdicciones con economías avanzadas contarán con legislación específica sobre responsabilidad de plataformas digitales. Las empresas que no anticipen este cambio pagarán costos mucho más altos que 375 millones.

La Dimensión de Inteligencia Artificial en este Fallo Judicial

Aunque el caso de Nuevo México se enmarca dentro de la legislación de protección al consumidor, su relevancia para el ecosistema de inteligencia artificial es directa e inmediata. En este 2026, las plataformas digitales más poderosas del planeta están integrando motores de recomendación basados en inteligencia artificial que determinan qué contenido ve cada usuario, cuánto tiempo permanece en la aplicación y a qué estímulos emocionales responde con mayor intensidad.

La pregunta que este fallo instala en la agenda corporativa global es la siguiente: si los algoritmos de recomendación —diseñados con inteligencia artificial— amplifican daños conocidos y documentados, ¿quién es el responsable legal? ¿El modelo, la empresa que lo despliega, o los directivos que tomaron la decisión de implementarlo sin revelar sus efectos?

Esta es exactamente la discusión que en iamanos.com llevamos al centro de cada implementación de inteligencia artificial que desarrollamos para nuestros clientes. Una estrategia de inteligencia artificial sostenible para 2026 y 2027 no puede construirse sin un marco robusto de ética, transparencia y trazabilidad algorítmica.

Los algoritmos de recomendación bajo el microscopio legal

Los sistemas de recomendación de Meta —y en general de todas las grandes plataformas de contenido— utilizan modelos de aprendizaje profundo entrenados para optimizar métricas de participación. El problema documentado desde hace años es que estas métricas de participación frecuentemente se correlacionan con contenido que genera respuestas emocionales intensas: indignación, miedo, comparación social negativa. Cuando una empresa tiene evidencia interna de que estos efectos ocurren y aún así no los revela ni los mitiga, el argumento legal de “práctica abusiva” encuentra terreno fértil. El fallo de Nuevo México es la primera materialización financiera masiva de ese argumento en suelo estadounidense, y no será la última.

La responsabilidad del diseño intencionado: más allá de la neutralidad tecnológica

Durante años, las grandes tecnológicas operaron bajo el escudo conceptual de la “neutralidad de la plataforma”: la tecnología es una herramienta, y la responsabilidad recae en el usuario. Este fallo destruye ese argumento de forma jurídica y empírica. El jurado determinó que cuando una empresa diseña activamente su producto para generar comportamientos específicos —y conoce los daños asociados a esos comportamientos—, ya no puede invocar la neutralidad. Este principio tiene implicaciones directas para cualquier empresa que hoy despliegue sistemas de inteligencia artificial orientados a personalización, recomendación o modificación de comportamiento. La ética algorítmica deja de ser una opción de relaciones públicas y se convierte en un imperativo legal.

Lecciones Estratégicas para Empresas que Operan con Inteligencia Artificial

El fallo contra Meta en Nuevo México debe leerse como un manual de lo que no debe hacerse, y simultáneamente, como una guía de lo que los líderes empresariales deben implementar de forma proactiva. En iamanos.com trabajamos con directores de empresas en México y Latinoamérica que están integrando inteligencia artificial en sus operaciones, y este caso nos obliga a reforzar un mensaje que hemos sostenido desde nuestra fundación: la transparencia algorítmica no es un costo, es una inversión en supervivencia corporativa.

Para cualquier empresa que hoy gestione una plataforma digital o despliegue soluciones basadas en inteligencia artificial, las implicaciones prácticas de este fallo son cinco:

1. Auditoría de comunicaciones públicas: Todo mensaje institucional sobre seguridad, privacidad o bienestar del usuario debe ser verificable con datos internos reales.

2. Trazabilidad algorítmica: Cada decisión tomada por un sistema de inteligencia artificial debe poder explicarse y documentarse. Si no puedes explicar por qué tu algoritmo tomó una decisión, no deberías desplegarla en producción.

3. Protocolos de divulgación de riesgos: Si tu sistema genera efectos secundarios conocidos, documentarlos y comunicarlos proactivamente es la única defensa legal sólida.

4. Gobernanza de datos interna: Los documentos internos que Meta no quería que vieran son hoy el centro del caso. La gobernanza de la información interna sobre efectos de tus productos es tan importante como el producto mismo.

5. Asesoría legal y técnica simultánea: La intersección entre derecho y tecnología requiere equipos que hablen ambos idiomas. Las empresas que operen sistemas de inteligencia artificial sin asesoría jurídica especializada están asumiendo riesgos existenciales.

Si tu empresa está desarrollando o planea desarrollar soluciones de inteligencia artificial para atención al cliente o cualquier interacción directa con usuarios finales, estos cinco puntos no son opcionales. Son la diferencia entre escalar con solidez o enfrentar un jurado dentro de tres años.

El modelo de responsabilidad corporativa que exige el nuevo entorno regulatorio

El entorno regulatorio global en 2026 ya no admite la figura del ejecutivo tecnológico que “no sabía” lo que hacía su algoritmo. La Ley de Inteligencia Artificial de la Unión Europea, los marcos regulatorios emergentes en Brasil y México, y ahora los precedentes judiciales en Estados Unidos están construyendo un consenso claro: los directivos son responsables de los sistemas que despliegan. Esto cambia radicalmente la relación entre los consejos de administración y los equipos técnicos. Los CEO y directores de tecnología necesitan ahora una comprensión funcional de cómo operan sus sistemas de inteligencia artificial, no solo una visión de los resultados de negocio que generan. En iamanos.com, preparamos a los líderes empresariales para exactamente este nuevo estándar.

El precedente y su efecto multiplicador en litigios futuros

Un veredicto de jurado en un caso civil en Estados Unidos no crea jurisprudencia vinculante a nivel federal, pero sí actúa como una señal de mercado poderosa. Cuando un jurado de ciudadanos comunes determina que una empresa “engañó” a sus usuarios, ese lenguaje se convierte en una herramienta narrativa y legal que otros estados, países y organismos regulatorios adoptarán. Los analistas del sector estiman que en los próximos 18 meses, al menos 12 jurisdicciones adicionales iniciarán investigaciones formales contra plataformas digitales usando este fallo como referencia. Las empresas que no ajusten sus prácticas hoy estarán respondiendo a múltiples frentes litigiosos de forma simultánea en 2027.

México ante la Regulación Digital: Una Oportunidad que No Podemos Ignorar

Para las empresas mexicanas que operan en el espacio digital, este fallo tiene una lectura estratégica dual. Por un lado, la señal regulatoria global indica que los estándares de responsabilidad sobre plataformas digitales se elevarán de forma acelerada en los próximos años. Por otro lado, representa una oportunidad única para las empresas que construyan desde ahora una arquitectura de confianza y transparencia, diferenciándose de los actores globales que han operado sin esos estándares.

En iamanos.com creemos que México tiene una ventana de oportunidad para establecerse como un referente regional en gobernanza tecnológica responsable. Las empresas que hoy integren la ética algorítmica en su ADN corporativo no solo evitarán multas millonarias: construirán ventajas competitivas duraderas en mercados donde la confianza del consumidor digital se está convirtiendo en el activo más escaso.

Si tu empresa está evaluando cómo escalar sus operaciones digitales con inteligencia artificial de forma responsable, el análisis de automatización inteligente de flujos complejos o la implementación de sistemas de ventas con inteligencia artificial debe incluir desde el diseño inicial los protocolos de transparencia que este nuevo entorno legal exige.

La pregunta no es si la regulación llegará a México. La pregunta es si tu empresa estará lista cuando llegue.

Puntos Clave

El veredicto contra Meta en Nuevo México marca un punto de inflexión irreversible en la relación entre las grandes plataformas digitales y sus responsabilidades legales frente a los usuarios. Los 375 millones de dólares en multas son solo la superficie de un cambio estructural más profundo: la era en que las empresas tecnológicas podían operar sin consecuencias reales por sus decisiones algorítmicas ha terminado. De cara a 2027, los líderes empresariales que integren la ética, la transparencia y la trazabilidad como pilares de su estrategia digital no solo estarán cumpliendo con la ley: estarán construyendo las empresas más sólidas y confiables de su industria. En iamanos.com acompañamos a nuestros clientes en exactamente ese camino: inteligencia artificial de alto rendimiento con responsabilidad de nivel institucional.

Lo que necesitas saber

Porque un jurado de ciudadanos determinó formalmente que Meta actuó de forma deliberada para engañar a sus usuarios sobre la seguridad de sus plataformas, calificándolo como práctica comercial abusiva. Esto eleva el estándar de responsabilidad más allá de la negligencia simple y otorga argumentos jurídicos sólidos a reguladores y fiscales en otras jurisdicciones del mundo.

Implica que cualquier empresa que despliegue sistemas de inteligencia artificial orientados a personalización o modificación de comportamiento debe documentar sus efectos conocidos, comunicarlos de forma transparente y contar con protocolos de gobernanza algorítmica. La “neutralidad tecnológica” ya no es una defensa legal válida cuando la empresa tiene evidencia interna de los daños generados.

Implementando desde el diseño de sus productos: auditorías de comunicaciones públicas, trazabilidad de decisiones algorítmicas, protocolos de divulgación de riesgos y gobernanza de datos interna. Contar con asesoría técnica y legal simultánea es el estándar mínimo para operar plataformas digitales con seguridad jurídica en 2026.

En términos financieros directos, no son una cifra devastadora para una empresa de la magnitud de Meta. Sin embargo, el daño real es el precedente legal que crea y la señal que envía a reguladores de todo el mundo, lo que podría derivar en decenas de litigios simultáneos en múltiples jurisdicciones en los próximos 18 a 24 meses.

Aunque el caso se enmarca en legislación de protección al consumidor, sus principios aplican directamente a los sistemas de inteligencia artificial. Los algoritmos de recomendación basados en inteligencia artificial son los mecanismos centrales de las plataformas de Meta, y su diseño para maximizar participación a costa del bienestar del usuario es exactamente lo que el jurado evaluó. Esto convierte el fallo en una referencia directa para reguladores de inteligencia artificial en todo el mundo.

IAmanos · Agencia de Inteligencia Artificial

Implementa IA en tu empresa este mes

Desde automatización hasta agentes autónomos. Cotiza gratis y recibe propuesta en 24h.

Convierte este conocimiento en resultados

Nuestro equipo implementa soluciones de IA para empresas B2B. Agenda una consultoría gratuita.